こんにちは。NEO(x) の宮脇(@catshun_)です。

先日 OpenAI から 12 Days of OpenAI がありましたが、同時に Google のリリースも注目されていたのでこちらにまとめます。

- Gemini 2.0

- Gemini 2.0 を使用するプロジェクト例

- Deep Research

- Veo 2

- Imagen 3

- Whisk

- NotebookLM Plus

- Android XR

- Google Agentspace

- おわりに

Gemini 2.0

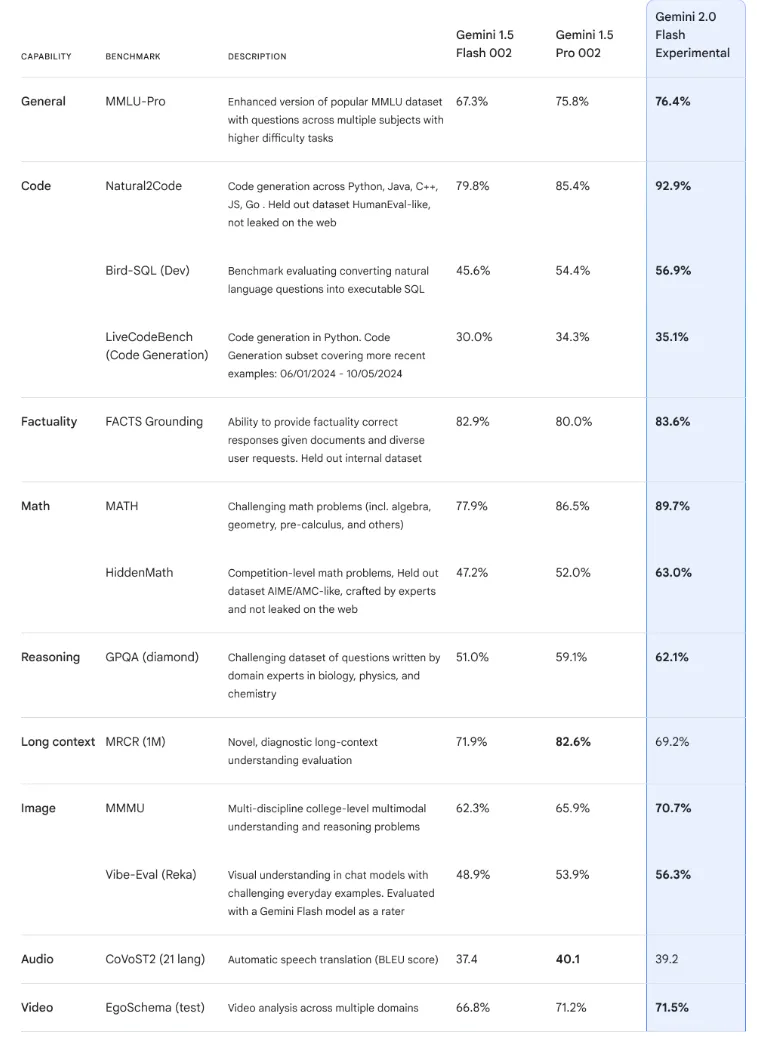

Google から新たにリリースされた Gemini 2.0 Flash は、これまでで最も人気の高かった 1.5 Flash をベースにさらなる進化を遂げたモデルです。

1. パフォーマンスの大幅な改善

- 主要なベンチマークで「1.5 Pro」の2倍の速度を実現。

- 高速な応答時間を維持しながら、より優れた性能を提供。

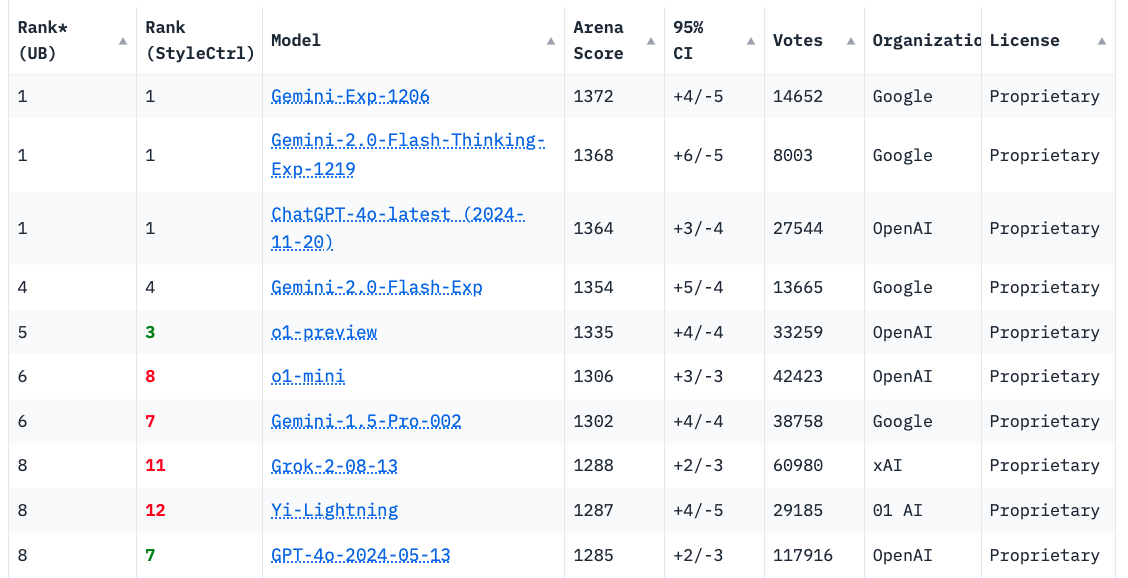

また Chatbot Arena でも Gemini 2.0 Flash Exp は上位の性能を示しています。

空間理解が向上したことで、雑然とした画像内の小さなオブジェクトに対してより正確な境界ボックスを生成できるようになり、オブジェクトの識別とキャプションも向上しました。

2. マルチモーダル I/O の対応

- 画像、ビデオ、オーディオなどの多様な入出力形式に対応。1回のAPI呼び出しで実行可能。

- テキストと多言語対応の音声合成を組み合わせたネイティブ生成画像をサポート。

Gemini 2.0 Flash にはネイティブのテキスト読み上げオーディオ出力が搭載されており、開発者は8つの高品質な音声とさまざまな言語やアクセントから選択して、モデルの読み上げ内容だけでなく読み上げ方もきめ細かく制御できます。

また画像が生成もサポートされ、マルチターン会話を通した編集ができるようになりました。テキストと画像をインターリーブして出力できるため、レシピなどのマルチモーダル コンテンツで役立ちます。

またマルチモーダルライブAPIでは、開発者がカメラや画面からのオーディオおよびビデオ ストリーミング入力を使用して、リアルタイムのマルチモーダルアプリケーションを構築できるようになりました。中断や音声アクティビティの検出などの自然な会話パターンもサポートされています。

他にも、コードリポジトリをデバイスから直接 Gemini Advanced にアップロードする機能も追加されています。プロジェクトの包括的なコンテキストを念頭に置いて、コードをデバッグ、リファクタリング、書き直し、最適化します。

You can now upload your code repository directly from your device into Gemini Advanced to streamline your workflows.

— Google Gemini App (@GeminiApp) 2024年12月19日

Debug, refactor, rewrite, & optimize your code with the comprehensive context of your project in mind.

🧑💻 Try it out → https://t.co/Yh38BPvqjp pic.twitter.com/l2U61Y5P2f

3. ネイティブツールの呼び出し

- Google 検索やコード実行、さらにサードパーティが定義したカスタム関数を直接利用可能。

Google 検索をツールとしてネイティブに使用すると、より事実に基づいた包括的な回答が得られ、パブリッシャーへのトラフィックが増加します。複数の検索を並行して実行できるため、複数のソースから同時に関連性の高い事実を見つけ、それらを組み合わせて正確性を高めることで、情報検索が向上します。

4. Gemini 2.0 Flash Thinking Exp モデルのリリース

Gemini 2.0 Flash 思考モードは、回答の一部としてモデルが行う「思考プロセス」を生成するようにトレーニングされた試験運用版モデルです。

Gemini 2.0 を使用するプロジェクト例

1. Project Astra

Project Astra は、現実世界でマルチモーダル理解を活用するエージェントプロジェクトで、Gemini アプリや AI アシスタントなどの Google 製品や、メガネなどの他のフォームファクターへの導入を目指しています。

2. Project Mariner

Mariner は、ブラウザから始めて人間とエージェントのインタラクションの将来を探求する、Gemini 2.0 で構築された初期の研究プロトタイプです。ブラウザ画面内のピクセルや、テキスト、コード、画像、フォームなどの Web 要素を含む情報を理解して推論し、実験的な Chrome 拡張機能を介してその情報を使用してタスクを完了することができます。

ブラウザ内でのナビゲーションを安全かつ責任を持って構築するために、新しいタイプのリスクと緩和策について積極的な研究を行っているようで、ブラウザのアクティブなタブでのみ入力、スクロール、クリックすることができ、何かを購入するなど、特定の機密性の高いアクションを実行する前にユーザーに最終確認を求めるようになります。

3. Jules

Jules は、GitHub ワークフローに直接統合される実験的な AI 搭載型のコードエージェントです。開発者の指示と監督の下で、問題に取り組み、計画を立て、実行することができます。

非同期で動作し、GitHub ワークフローと統合された Jules は、バグ修正やその他の時間のかかるタスクを処理し、ユーザーが実際に構築したいものに集中できるようにします。Jules は、問題に対処するための包括的な複数ステップの計画を作成し、複数のファイルを効率的に変更し、修正を直接 GitHub に戻すためのプルリクエストを準備します。

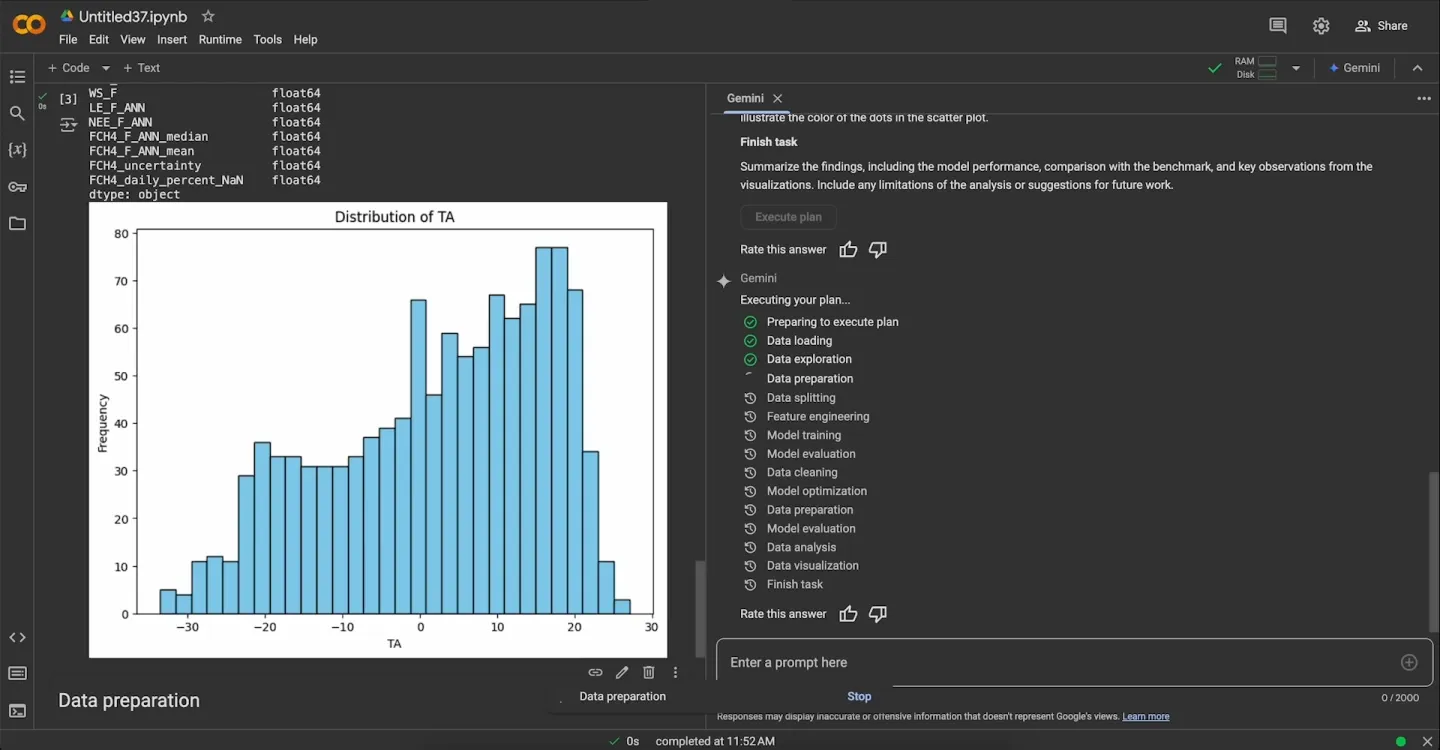

4. Data Science Agent

Data Science Agent は、実験的なデータサイエンス エージェントで、これによりデータセットをアップロードして数分以内に分析情報を取得でき、すべて Colab ノートブック上で実行できるようになります。

Google Colab は、Gemini 2.0 を使用して、同じエージェント機能を統合し始めており、分析の目標をわかりやすい言葉で説明するだけで、ノートブックが自動的に形になり、調査やデータ分析の実施能力が向上します。

Deep Research

Deep Research は、Gemini Advanced で利用可能なAIエージェント機能です。ユーザーに代わって徹底的な調査を実行し、複数のソースから包括的なレポートを数分で作成します。

現在、日本語での対応もされており、Genspark, Perplexity のような網羅的な検索に基づく応答生成を行います。使い方については以下をご覧ください。

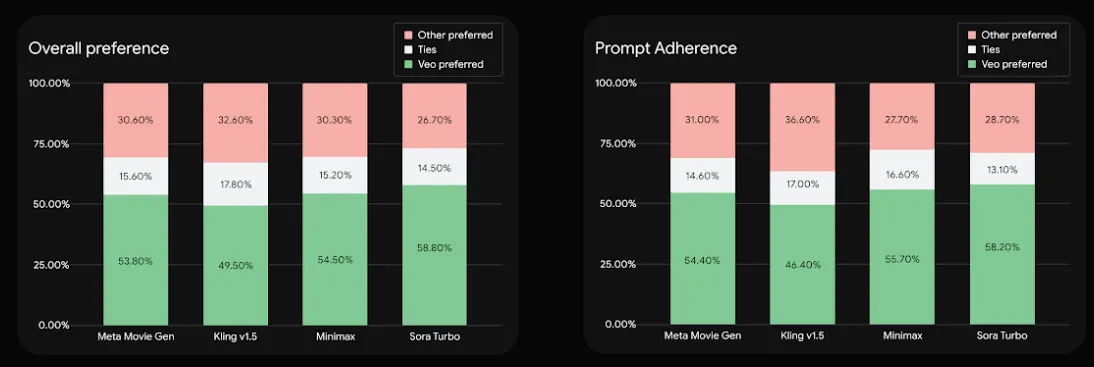

Veo 2

Veo 2 は、幅広いテーマやスタイルで驚くほど高品質な動画生成モデルです。現実世界の物理法則や人間の動きと表情のニュアンスに対する理解が深まり、全体的なディテールとリアリティが向上しています。

Veo 2 は映画撮影の独特な言語を理解しています。ジャンルを尋ね、レンズを指定し、映画効果を提案すれば、Veo 2 は最大 4K の解像度で、数分の長さまで延長してそれを実現します。例えば「18mm レンズ」という指示で広角ショットを作成したり、「浅い被写界深度」で背景をぼかして被写体に焦点を合わせたりすることもできます。

Veo 2 は、ヒトによる比較評価においても、他の動画生成モデルに対して最先端の結果を達成しており、プロンプトへの追従性やヒトによる選好性において優れたモデルであることが分かります。

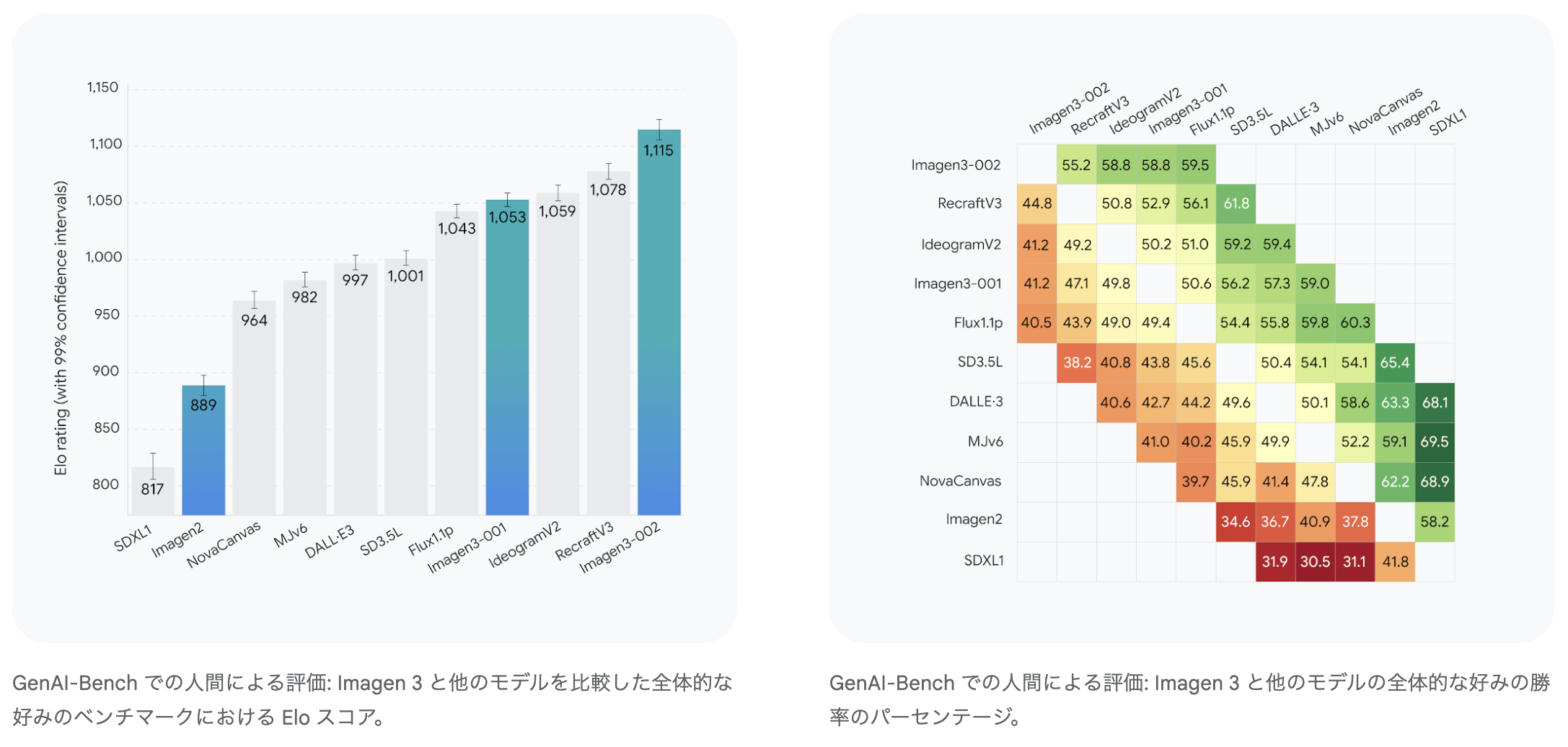

Imagen 3

Imagen 3 は高品質な画像生成モデルで、フォトリアリズムから印象派、抽象からアニメまで、より多様なアートスタイルをより高い精度で生成します。プロンプトへの忠実性も高く、より豊かなディテールとテクスチャをレンダリングします。

Imagen 3 は、生成品質の評価においても高いスコアを獲得しており、魅力的で忠実な画像を生成することが分かります。

Whisk

Whisk は、思い描いている主題、シーン、スタイルを容易に生成するためのツールです。これらを組み合わせてリミックスし、デジタルぬいぐるみからエナメルピンやステッカーまで、自分だけのユニークなものを作成できます。

NotebookLM Plus

NotebookLM は、ソースに基づいて新しいコンテンツを管理および生成するために最適化された新しいインターフェースで、RAG ツールとしても広く知られています。オーディオ機能も提供されており、特定のソースに関する情報を Podcast として聴くことも可能です。

今回の発表では、オーディオ概要中にAIホストと直接やり取りする機能が発表されました。音声を介して、ホストに詳細を尋ねたり、概念を別の方法で説明してもらうことが可能となり、情報源の知識を基に直接応答する個人指導員やガイドがいるような体験を提供します。

Android XR

Samsung とのコラボレーションで開発された Android XR は、ヘッドセットやメガネに役立つエクスペリエンスを実現します。

ヘッドセットを使用すると、仮想環境に完全に没入する状態と現実世界に留まる状態を簡単に切り替えることができます。周囲の空間をアプリやコンテンツで埋め尽くすことができ、AI アシスタントの Gemini を使用すると、見ているものについて会話したり、デバイスを操作したりすることもできます。Gemini はユーザーの意図を理解し、計画やトピックの調査を手伝い、タスクをガイドします。

Android XR は将来、一日中使えるメガネもサポートする予定です。Android XR 搭載のメガネは、タップ 1 回で Gemini のパワーを発揮し、スマートフォンを取り出さなくても、必要なときに道順、翻訳、メッセージの概要など、役立つ情報を提供します。

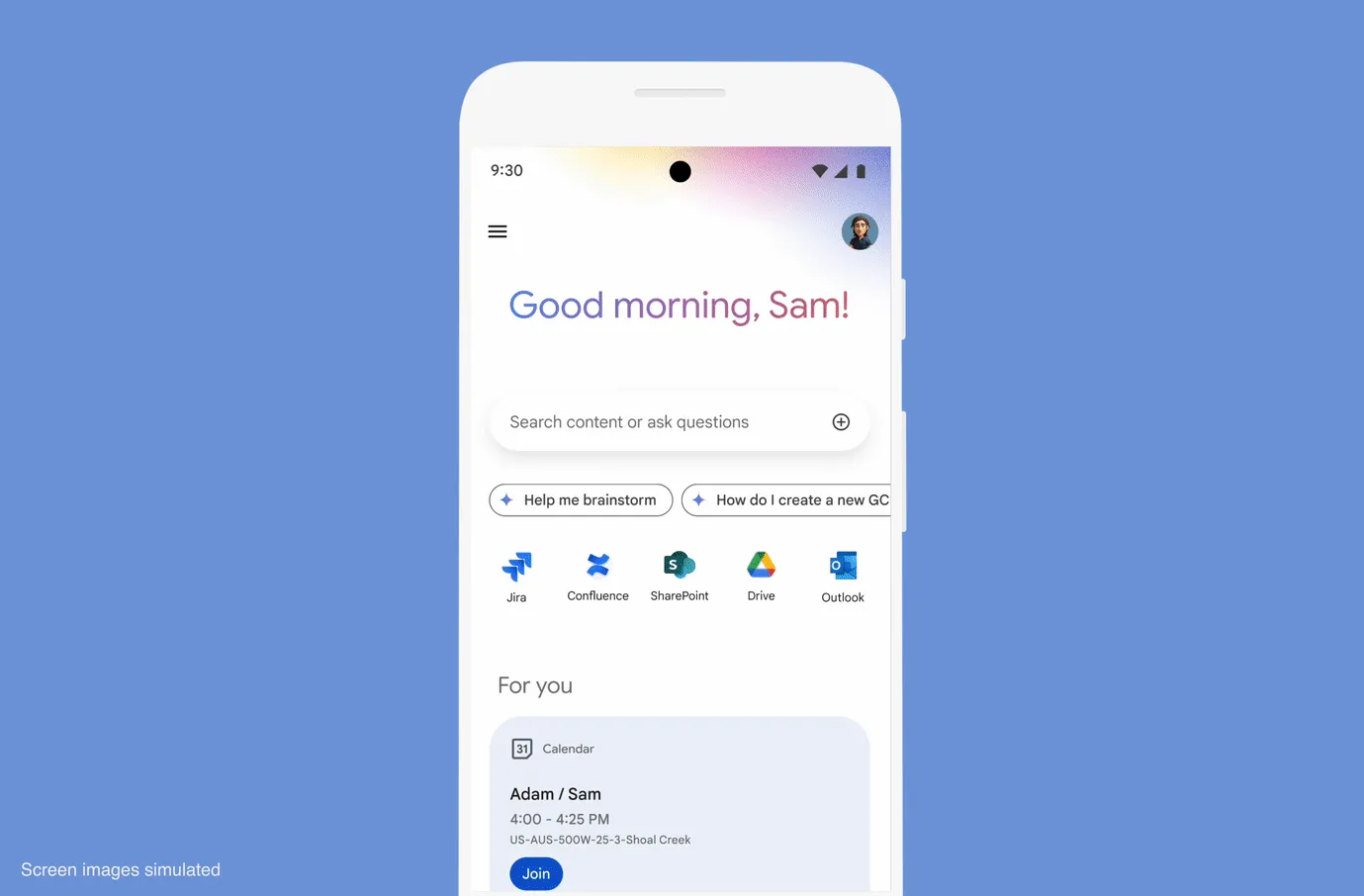

Google Agentspace

Google Agentspace は、計画、調査、コンテンツ生成、アクションを必要とする複雑なタスクをすべて 1 つのプロンプトで達成できるように支援することで、従業員の生産性を大幅に向上させます。

1. 企業全体での情報発見

従業員に単一の企業ブランドのマルチモーダル検索エージェントを提供し、組織全体の企業の真実を集約する中心的な情報源として機能します。会話によるサポート、複雑な質問への回答、プロアクティブな提案、企業固有の情報に基づいたアクションの実行などを提供します。

Google Agentspace は、ドキュメントやメールなどの非構造化データと表などの構造化データの両方でこの処理を実行できます。翻訳機能も組み込まれているため、別の言語で作成された情報であっても、すべての情報を理解できます。

Confluence、Google ドライブ、Jira、Microsoft SharePoint、ServiceNow など、最も一般的に使用されるサードパーティ アプリケーション用のコネクタがあらかじめ構築されているため、従業員は関連するデータソースに簡単にアクセスしてクエリを実行し、より適切な意思決定を行うことができます。

2. ビジネス機能を自動化するエキスパートエージェント

Google Agentspace は、コンテキストに応じて生成 AI を適用するカスタム AI エージェントの出発点です。企業は、マーケティング、財務、法務、エンジニアリングなどの従業員が、より優れた調査を実施し、コンテンツを迅速に作成し、複数ステップのワークフローを含む反復タスクを自動化できるように支援できるようになります。

従業員が組織のエージェントを簡単に見つけてアクセスできる単一の場所を提供することで、従業員は Agentspace でローコードのビジュアルツールを使用して独自のエキスパートエージェントを構築や調整ができるようになります。

おわりに

今年は OpenAI, Google, Anthropic など各社から数多くの AI リリースがありましたね。来年は AI エージェントの年になるといわれているので、引き続きキャッチアップしていきたいと思います。

また 12 Days of OpenAI に関しては CEO の大野が PIVOT で解説しているのでご覧いただけると幸いです。

また Algomatic では 生成AI×事業開発を行なっています。興味がある方は下記リンクからカジュアル面談の応募ができるのでぜひお話ししましょう!

生成AI領域にしぼった転職エージェント

Algomatic グループでは、生成AI領域への転職を考えている方と並走してキャリア相談や転職相談をおこなう転職エージェントサービス 『.AI CAREER』 を展開しています。

転職を考えている方は、こちらから無料登録できます:

またAI人材を募集している企業の皆様は、works@algomatic.jp よりご相談ください!